2026年4月9日发布

开篇引入

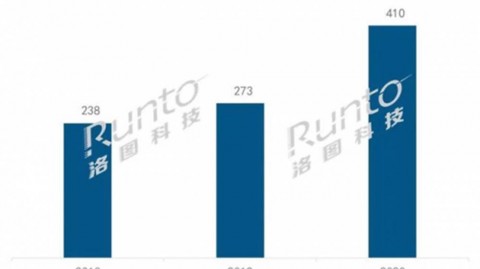

如果你正在准备AI Agent方向的面试,或者刚接触智能体开发却感觉概念一团乱麻,那么这篇文章就是你需要的起点。AI Agent(智能体) 是当前大模型领域最受关注的应用方向——根据Gartner的数据,2025年全球AI Agent市场规模已达到428亿美元,预计2026年将突破620亿美元,年复合增长率高达45%,企业级应用渗透率从2024年的32%跃升至2025年的58%-4。许多学习者的真实困境是:会调用API、能搭简单的对话机器人,但一被问到“Agent与RPA有什么区别”“LLM如何驱动决策”就答不上来。本文将从痛点出发,由浅入深讲清AI Agent的核心概念、底层原理与面试考点,帮你建立完整的知识链路。

一、痛点切入:为什么需要AI Agent?

我们先看一段传统自动化方案的代码。假设要用脚本从网页上抓取数据并填写表单:

传统RPA脚本示例(基于Selenium) from selenium import webdriver from selenium.webdriver.common.by import By import time driver = webdriver.Chrome() driver.get("https://example.com/report") 痛点1:强依赖固定UI元素定位 report_btn = driver.find_element(By.XPATH, "//div[@class='report-container']/button[2]") report_btn.click() time.sleep(3) 痛点2:一旦页面改版,XPath立即失效 data_table = driver.find_element(By.ID, "data-table-v1") rows = data_table.find_elements(By.TAG_NAME, "tr") for row in rows: 痛点3:只能处理结构化数据 cells = row.find_elements(By.TAG_NAME, "td") if len(cells) >= 2: print(f"{cells[0].text}: {cells[1].text}")

传统RPA的典型问题:强依赖XPath等固定UI定位、无法理解非结构化内容、UI更新即失效。传统自动化只能执行“if-then”规则逻辑,缺乏理解意图、规划任务和动态调整的能力-13。

AI Agent的解决思路:不再预设固定路径,而是让Agent理解用户的自然语言指令,自主拆解任务、调用工具、感知界面变化并动态调整执行策略。正如中国工业互联网研究院发布的报告所定义的,新一代AI Agent正从传统的“自动化”任务执行迈向基于意图理解与环境感知的“自主性”-15。

二、核心概念讲解:什么是AI Agent?

AI Agent,全称Artificial Intelligence Agent,即人工智能智能体。它是一个能够感知环境、自主决策、执行行动并持续学习的智能实体。

拆解核心关键词:

感知:理解用户输入和当前状态

决策:基于理解规划行动路径

行动:调用工具、操作界面完成具体任务

学习:通过记忆优化后续行为

生活化类比:传统AI问答就像“咨询顾问”——你问什么,它答什么。而AI Agent更像一个“实习生”——你给它一个目标(比如“帮我订明天去北京的机票”),它自己会去查航班、比价格、选座位、完成支付,最后告诉你结果。

Agent的价值在于:将大模型的认知能力与系统的执行能力打通,让AI从“会说”进化到“会做”-31。

三、关联概念讲解:什么是LLM?

LLM,全称Large Language Model,即大语言模型。它是基于Transformer架构,通过海量文本数据预训练而成的深度神经网络模型,拥有数十亿乃至万亿参数-。

Agent与LLM的关系:

LLM是Agent的“大脑” ,提供理解、推理和生成能力

Agent是LLM的“身体” ,赋予LLM感知环境、调用工具、执行动作的能力

简单示例:当用户说“明天下午3点提醒我开会”:

仅用LLM:模型理解这句话,但无法真正设置提醒

Agent方案:LLM理解意图 → Agent调用日历API → Agent创建提醒事件 → 返回确认结果

四、概念关系与区别总结

| 维度 | AI Agent | LLM |

|---|---|---|

| 角色 | 自主决策与执行实体 | 认知与生成引擎 |

| 核心能力 | 感知→规划→行动→记忆闭环 | 语言理解与生成 |

| 对外交互 | 操作应用、调用工具、完成目标 | 回答问题、生成内容 |

| 依赖关系 | 依赖LLM作为核心组件 | 不依赖Agent独立运行 |

一句话记忆:LLM是“会思考的大脑”,Agent是“有手有脚的智能体”——前者提供认知,后者实现执行。

五、代码示例:构建一个最小化AI Agent

以下是一个使用LangChain构建的极简Agent示例:

from langchain.agents import create_react_agent, Tool, AgentExecutor from langchain_openai import ChatOpenAI from langchain.tools import tool import requests 定义工具1:天气查询 @tool def get_weather(city: str) -> str: """查询指定城市的实时天气""" 实际开发中替换为真实API return f"{city}当前天气:晴,25°C,湿度60%" 定义工具2:计算器 @tool def calculator(expression: str) -> str: """执行数学计算""" return str(eval(expression)) 定义工具3:当前时间 @tool def get_current_time() -> str: """获取当前时间""" from datetime import datetime return datetime.now().strftime("%Y-%m-%d %H:%M:%S") 1. 初始化LLM作为大脑 llm = ChatOpenAI(model="gpt-4o-mini", temperature=0) 2. 配置工具集 tools = [get_weather, calculator, get_current_time] 3. 创建Agent(LLM + 工具 + 提示词模板) agent = create_react_agent(llm, tools, prompt_template) 4. 创建Agent执行器 agent_executor = AgentExecutor(agent=agent, tools=tools, verbose=True) 5. 执行任务 response = agent_executor.invoke({ "input": "帮我查一下上海今天天气怎么样,然后告诉我现在几点了" }) print(response["output"])

执行流程说明:

用户输入“查上海天气和当前时间”

Agent的LLM模块解析意图,识别需要调用的工具

Agent依次调用

get_weather(“上海”)和get_current_time()Agent整合两个工具返回的结果,生成最终回复

六、底层原理与技术支撑

AI Agent能够实现上述能力,背后依赖以下关键技术:

1. 感知-规划-行动-记忆的认知闭环

根据中国工业互联网研究院发布的《AI Agent智能体技术发展报告》,现代AI Agent依托感知、大脑、行动与记忆四大模块,构建起“感知→决策→行动→记忆”的闭环架构-15:

感知模块:采集多源信息并结构化处理

大脑模块:以大语言模型为核心,理解意图并拆解任务

行动模块:调用工具执行操作

记忆模块:通过短期与长期记忆优化服务

2. ReAct(推理+行动)框架

ReAct通过交替执行“思考”和“行动”步骤实现复杂任务。Agent在收到指令后,会先输出推理过程,再选择动作执行,根据执行结果继续推理,形成循环-31。

3. 工具调用与Function Calling

Agent需要将用户的自然语言意图映射为结构化的函数调用参数,调用外部API或执行本地操作-30。

4. 多智能体协同

面对复杂任务时,单一Agent往往力不从心。多智能体系统通过将任务拆解并交由不同专长的Agent协作完成,实现专业化分工与任务并行提速-15。

七、高频面试题与参考答案

Q1:AI Agent与传统AI系统(如规则引擎、RPA)的核心区别是什么?

答案要点:

自主性:Agent能动态生成解决方案,而非依赖预设规则

上下文感知:通过多轮交互维持任务连贯性

工具集成:可调用外部API或数据库完成复杂操作

学习能力:具备记忆机制,能从交互中持续优化

踩分点:强调从“被动响应”到“主动执行”的范式转变-31。

Q2:解释ReAct框架的工作机制。

答案要点:

ReAct = Reasoning(推理)+ Acting(行动)

工作流程:观察输入 → 推理分析 → 选择行动 → 执行 → 接收反馈 → 迭代

优势:减少模型幻觉,提升任务成功率

踩分点:能够说清楚“思考”和“行动”的交替循环-31。

Q3:Agent中的记忆机制如何设计?

答案要点:

短期记忆:利用LLM的上下文窗口,存储当前会话信息

长期记忆:使用向量数据库(如ChromaDB、Pinecone)存储跨会话的知识

协同方式:通过语义实现跨会话知识复用-30

踩分点:区分短期与长期记忆,说明向量数据库的应用。

Q4:如何优化Agent的响应延迟?

答案要点:

量化延迟来源(模型推理占60%,工具调用占30%)

模型轻量化:使用蒸馏技术或小参数模型

工具调用并行化:使用

concurrent.futures缓存机制:对常见查询结果进行缓存

踩分点:能给出量化的优化策略,体现工程思维-30。

Q5:Agent与RPA的核心区别是什么?

答案要点:

RPA基于规则和脚本,强依赖UI元素定位(如XPath)

Agent通过自然语言理解和视觉感知,自适应UI变化

Agent能处理非结构化数据(如PDF、聊天记录),RPA主要处理结构化输入

踩分点:能对比两者的技术范式差异-38-40。

八、结尾总结

回顾全文核心要点:

AI Agent的核心价值:将大模型的“认知力”转化为系统的“执行力”,实现从“会聊天”到“能干活”的跨越

关键技术栈:感知-规划-行动-记忆闭环 + ReAct推理框架 + 工具调用 + 多智能体协同

面试高频考点:Agent与LLM的关系、与RPA的区别、ReAct机制、记忆设计、延迟优化

重点提醒:不要将Agent等同于简单的对话机器人——真正的Agent必须具备自主决策和工具调用能力,这是面试中最容易被追问的深层考点。

后续预告:下一篇将深入探讨多智能体系统的架构设计与实战,包括CrewAI框架的使用、智能体间通信协议(A2A)以及企业级Agent落地的最佳实践,敬请期待!