时间戳:2026年4月9日

开篇引入

你是否还在每天重复着同样的工作流程——打开文档、资料、整理周报、设置提醒?你是否曾经幻想过,如果能有一个专属的AI助手长期住在你的电脑里,随时帮你处理这些琐事,该有多省心?这正是AI本地助手要解决的问题。从云端AI到本地AI,从被动对话到主动执行,2026年正成为AI Agents爆发元年-33。大多数开发者仍停留在“会用云端API”的阶段,对本地化部署的AI助手存在理解盲区:概念混淆(Agent vs 传统工具)、原理不清(本地推理 vs 云端调用)、面试答不出(长期记忆 vs 短期会话)。本文将从痛点切入,带你由浅入深地掌握AI本地助手的核心概念、技术架构与落地实践,帮你建立起完整的知识链路。

一、痛点切入:为什么需要AI本地助手?

先看一段传统开发中常见的代码:

传统方式:依赖云端API的问答式AI调用 import requests def ask_chatbot(question): response = requests.post( "https://api.openai.com/v1/chat/completions", headers={"Authorization": "Bearer YOUR_API_KEY"}, json={"model": "gpt-4", "messages": [{"role": "user", "content": question}]} ) return response.json()["choices"][0]["message"]["content"] 每次调用都要等网络响应,每次对话都是全新的开始 print(ask_chatbot("帮我总结今天的邮件"))

这段代码暴露了传统云端AI工具的三大致命缺陷:

1. 网络依赖强:78%的开发者遭遇过“AI响应延迟导致服务中断”的困境-23。

2. 无长期记忆:主流云AI的记忆机制普遍采用会话级缓存,跨会话知识继承率不足30%-23。每次对话都像重新认识你,永远记不住三分钟前聊过什么。

3. 被动响应而非主动执行:尽管92%的AI工具能生成可执行方案,但真正具备任务闭环能力的不足7%-23。它能告诉你“该做什么”,却不会帮你“做完”。

正是这些痛点催生了AI本地助手——一种可长期运行在本地设备、拥有持续记忆、能主动执行复杂任务的智能代理系统。2026年4月,华为在HarmonyOS 6中推出“小艺Claw”本地部署的主动式AI助理,小米的“超级小爱”PC客户端提前上线,标志着本地AI助手正式进入消费者市场--2。

二、核心概念讲解:AI本地助手

AI本地助手(Local AI Assistant) 是一种部署在用户本地计算设备(PC/手机/工作站)上、无需持续网络连接即可运行的智能代理系统。它以本地运行的大语言模型(Large Language Model, LLM) 为大脑,结合本地知识库、任务规划引擎和工具调用能力,实现对本地文件的深度理解、跨应用自动化操作和复杂任务的闭环执行。

生活化类比:云端AI像是你打电话咨询的客服热线——拨通、提问、挂断,下次再打换个客服,一切从头说起;而AI本地助手则是住在家里的私人管家——它了解你的习惯、记得你的偏好、随时等你吩咐,甚至在你开口之前就把事办好了。

核心价值体现在三个方面:

隐私安全:所有交互记录、知识图谱采用AES-256加密存储在本地,敏感数据无需经过第三方服务器-23

持续记忆:通过本地知识图谱记录用户的偏好、过往项目和习惯,越用越懂你-11

主动执行:从“被动响应”向“主动执行”跃迁,具备任务闭环能力-23

三、关联概念讲解:Agent、Skill与Skill Creator

理解AI本地助手,必须厘清三个层层递进的核心概念:

1. Agent(智能体)

以LLM为“大脑”,配备感知、记忆、推理决策和行动模块的自主决策实体-33。它不需要你给出明确的分步骤指令,只需给出一个抽象目标,就能自主感知环境、制定计划、调用工具、执行行动,直至完成目标。例如OpenClaw在GitHub上已获得超10万星,成为高级用户的首选工具-12。

2. Skill(技能/插件)

Skill是Agent执行具体任务的功能模块,可类比为手机的App。一个Agent可以搭载数十个Skill,每个Skill负责一类特定任务。例如AutoClaw预置了50+开箱即用技能,覆盖办公、代码、营销等场景-17;WorkBuddy预置20+办公技能包-17。

3. Skill Creator(技能创建器)

让用户零代码创建自定义Skill的工具。用户通过自然语言描述需求,Agent自动生成专属Skill。华为小艺Claw内置了skill-creator功能,用户只需说“帮我设置一个定时任务,每天18:15提醒我提交日报,收到周五的日报后帮我汇总成周报”,Agent就能自动创建对应的Skill-1。

一句话概括三者关系:Agent是“总管家”,Skill是“工具箱”,Skill Creator是“工具制造机”。

对比理解:

| 概念 | 定位 | 类比 |

|---|---|---|

| Agent | 智能体(大脑+躯干) | 人本身 |

| Skill | 具体能力模块 | 你会的一项技能 |

| Skill Creator | 技能生成工具 | 教你学新技能的老师 |

四、技术架构:五层解构AI本地助手

当前端侧AI智能体系统普遍采用五层技术架构-26:

┌─────────────────────────────────────────┐ │ 应用层(Application Layer) │ ← 日历/邮件/OA/文件管理 ├─────────────────────────────────────────┤ │ Agent框架层(Agent Framework) │ ← 意图识别/任务规划/上下文管理/工具调用 ├─────────────────────────────────────────┤ │ 模型层(Model Layer) │ ← NPU/GPU加速 + 大小模型协同推理 ├─────────────────────────────────────────┤ │ 系统层(System Layer) │ ← 系统API/文件/内存/安全隔离区(TEE) ├─────────────────────────────────────────┤ │ 硬件层(Hardware Layer) │ ← NPU/GPU/CPU/内存带宽/安全芯片 └─────────────────────────────────────────┘

关键能力点:

混合部署架构:基础模型运行在本地GPU/NPU,复杂计算可调用云端算力池-21。某测试数据显示,混合部署可使复杂任务处理延迟降低67%-21。

长期记忆系统:MemX等方案实现了本地优先的长期记忆,在标准场景下Hit@1达到91.3%-24。

隐私安全闭环:通过TEE(可信执行环境)实现数据不出设备,小米超级小爱支持创建本地个人AI知识库,用户机密信息在本地进行安全处理-2。

实际应用场景举例:华为小艺Claw搭载skill-creator后,用户可以零代码创建专属效率工具;安装“鸿蒙专区”Skill后,小艺Claw具备了与日历、备忘录、图库等本地APP自动化交互的能力-1。小米超级小爱PC版支持对电脑内的文档、音频进行免解压的深度与内容提炼-2。AI本地助手正从“对话”走向“执行”-。

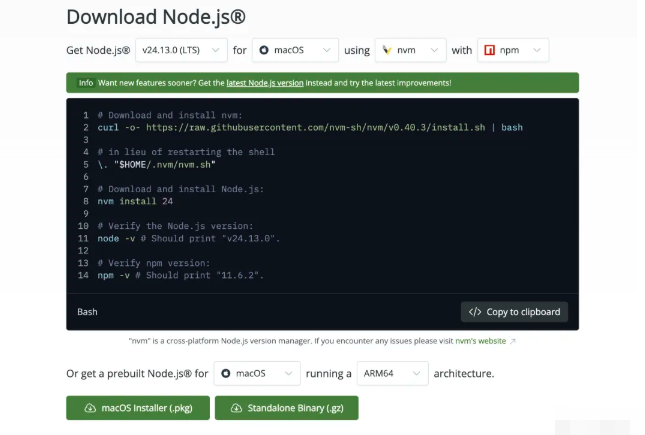

五、代码示例:从传统调用到本地Agent

传统方式(被动问答,无记忆,无法执行):

每次都要完整传上下文,无法执行实际操作 def chat_without_memory(user_input, history): full_prompt = "\n".join(history) + f"\n用户: {user_input}" 调用云端API... 返回文本,不做任何实际操作 return ai_response

本地Agent方式(有记忆 + 可执行 + 主动式):

伪代码:本地Agent核心流程 class LocalAgent: def __init__(self): self.memory = LocalKnowledgeGraph() 本地知识图谱,记录长期记忆 self.skills = SkillRegistry() 已注册的可用技能 self.planner = TaskPlanner() 任务规划器 def execute(self, goal: str): 1. 理解用户意图(自然语言 → 结构化任务) intent = self.intent_recognizer.parse(goal) 2. 检索长期记忆(偏好、历史、习惯) context = self.memory.recall(user_preferences) 3. 任务规划(将目标分解为可执行步骤) plan = self.planner.decompose(intent, context) 4. 调用本地技能执行(不依赖网络) for step in plan.steps: skill = self.skills.get(step.tool) result = skill.execute(step.params) 实际操作本地文件/应用 5. 更新记忆,主动反馈 self.memory.update(result) return result 使用示例 agent = LocalAgent() agent.execute("每天18:15提醒我提交日报,周五汇总成周报") 无需联网,Agent自动创建定时任务Skill,持续运行

新旧对比:传统方式需要开发者手动实现记忆管理、任务分解和工具调用,代码量数百行起步;而本地Agent框架将这些能力内化为标准组件,开发者只需配置即可获得完整功能。

六、底层原理与技术支撑

AI本地助手的能力建立在以下核心技术之上:

1. 本地大模型推理(LLM Inference on Device)

模型在本地GPU/NPU上运行,无需网络即可进行推理。Google与NVIDIA合作优化的Gemma 4模型(涵盖E2B、E4B、26B、31B变体),专为从边缘设备到高性能GPU的高效部署而设计,支持原生结构化工具调用(函数调用)-29。Google推出的AI Edge Gallery让用户在手机上本地运行Gemma 4等开源模型,所有AI推理都在设备上完成-31。

2. 本地知识图谱与长期记忆(Local Knowledge Graph & Long-Term Memory)

MemX采用Rust实现,基于libSQL和OpenAI兼容的Embedding API,通过向量召回、关键词召回、RRF融合排序和四因素重排序,实现了稳定优先的检索设计-24。关键词检索在10万条记录规模下延迟低于90毫秒-24。Memu等产品则构建本地知识图谱记录用户偏好和习惯,实现长期记忆-11。

3. 任务规划与工具调用(Task Planning & Tool Calling)

任务编排系统采用DAG结构管理依赖关系,支持条件分支与异常处理-21。Gemma 4原生支持结构化工具调用,允许Agent调用个人文件、应用程序和工作流-29-。

4. 隐私安全闭环(TEE & Encryption)

数据采用AES-256加密存储在本地,通过TEE(可信执行环境)实现安全隔离-23-26。部署在沙箱环境中的Agent(如Docker容器)可防止AI幻觉导致误删系统文件-11。

七、高频面试题与参考答案

Q1:什么是AI本地助手?与传统云端AI助手有什么核心区别?

A:AI本地助手是部署在用户本地设备上运行的智能代理系统,以本地LLM为大脑,具备长期记忆和主动执行能力。核心区别:(1)数据主权:数据本地加密存储,不离开设备;(2)记忆连续性:云端AI多为会话级记忆(跨会话继承率<30%),本地AI通过知识图谱实现长期记忆;(3)执行能力:云端AI被动响应文本,本地AI可主动操作本地文件和应用;(4)离线可用:本地AI无需网络即可运行基础推理。

Q2:AI本地助手的技术架构包含哪几层?

A:主流端侧AI智能体系统采用五层架构:硬件层(NPU/GPU加速)→ 系统层(安全隔离区TEE、系统API)→ 模型层(大小模型协同推理、量化加速)→ Agent框架层(意图识别、任务规划、工具调用、上下文管理)→ 应用层(日历、邮件、OA等应用集成)。

Q3:什么是长期记忆系统?如何实现?

A:长期记忆系统是让AI助手跨越多个会话记住用户偏好和上下文的技术方案。以MemX为例,其实现流程为:用户交互 → Embedding向量化 → 本地存储(libSQL)→ 检索时向量召回+关键词召回 → RRF融合排序 → 四因素重排序 → 返回记忆。检索延迟在10万条记录下低于90毫秒,Hit@1达到91.3%。

Q4:Agent、Skill、Skill Creator三者的关系是什么?

A:Agent是智能体,是整个系统的大脑和执行主体;Skill是具体能力模块,解决特定类型任务;Skill Creator是创建自定义Skill的工具。关系可概括为:Agent是“总管家”,Skill是“工具箱”,Skill Creator是“工具制造机”。Agent依赖Skill完成具体任务,Skill Creator扩展Agent的能力边界。

Q5:为什么2026年是AI本地助手的爆发元年?

A:(1)技术成熟:端侧大模型(Gemma 4等)支持本地高效推理,混合部署架构可降低67%延迟;(2)政策驱动:2026年政府工作报告首次提出“打造智能经济新形态”,明确促进智能体加快推广;(3)产品爆发:华为小艺Claw、小米超级小爱、OpenClaw(GitHub 10万星)等产品密集发布;(4)需求明确:用户对隐私安全和离线可用的需求日益强烈,本地化AI解决了云端AI的数据安全痛点。

八、结尾总结

本文围绕AI本地助手这一核心主题,梳理了从传统云端AI痛点→本地Agent架构→核心概念辨析→底层原理→面试要点的完整知识链路。

核心知识点回顾:

AI本地助手是部署在本地设备、拥有长期记忆和主动执行能力的智能代理系统

五层技术架构(硬件→系统→模型→Agent框架→应用层)支撑了本地AI的运行

Agent、Skill、Skill Creator三者层层递进,构成了完整的智能体生态

长期记忆(如MemX方案)和本地推理(如Gemma 4优化)是两大关键技术支柱

2026年受技术成熟、政策驱动和产品爆发三因素共振,已成为AI本地助手规模化落地元年

易错点提醒:不要将“简单的Prompt工程包装体”误认为真正的AI Agent,真正的Agent必须具备自主感知、自主决策和闭环执行能力-36。

进阶预告:下一篇将深入剖析OpenClaw、Memu、Nanobot三大主流本地AI框架的实战对比与部署指南,敬请期待。